OpenAI 祭出 120 亿参数魔法模型:从文本合成图像栩栩如生,仿佛拥有人类的语言想象力

2021 刚刚开启,OpenAI 又来放大招了!

能写小说、哲学语录的 GPT-3 已经不足为奇?那就来一个多模态『图像版 GPT-3』。

今天,OpenAI 重磅推出了最新语言模型—DALL·E,它是 GPT-3 的 120 亿参数版本,可以魔法一般按照自然语言文字描述直接生成对应图片!

比如,在 DALL·E 模型中输入 “穿芭蕾舞短裙、正在遛狗的萝卜宝宝”,它就可以生成这样一张图片:

输入 “鳄梨形状的扶手椅”,就是这样:

甚至输入 “含 OpenAI 字样的店铺”,它也能成生成多种设计图

DALL·E 这项神技能冲上了各大社交平台的热搜。

Keras 创始人 François Chollet 特意发文称:

这看起来非常酷,尤其是 “图像生成”的部分。从原理上来看,它应该就是 GPT-3 在文本合成图像方向上的扩展版本。

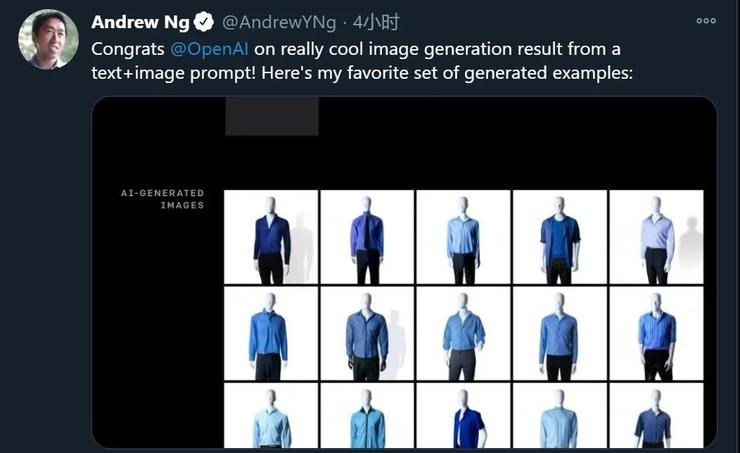

AI 大神吴恩达也第一时间转推点赞,还顺带挑选了一张满意的蓝色衬衫 + 黑色长裤的 AI 生成图。

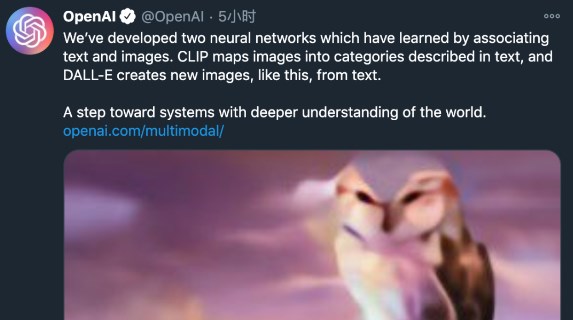

OpenAI 联合创始人、首席科学家 Ilya Sutskever 在推特上发文表道:人工智能的长期目标是构建多模态神经网络,即 AI 能够学习不同模态之间的概念(文本和视觉领域为主),从而更好地理解世界。而 DALL·E 和 CLIP 使我们更接近 “多模态 AI 系统”这一目标。

值得一提的是,DALL·E 的命名也很特别。这个善于绘画创作的模型名称来源于人类艺术家萨尔瓦多 · 达利(Salvador Dalí)和皮克斯(Pixar)机器人 WALL·E 名称的结合。

接下来,我们来详细介绍一下它还有哪些硬核能力。

DALL·E 的能力

DALL·E 能够为多语言成分结构的各种句子创造似是而非的图像。研究人员通过一些交互视觉效果举例说明了这一点。在下面的案例中,每个视觉效果的文本提示都是通过 CLIP 重新排序后,从 512 个文本提示中的前 32 个获得的,不采取任何手动选取(cherry-picking)。

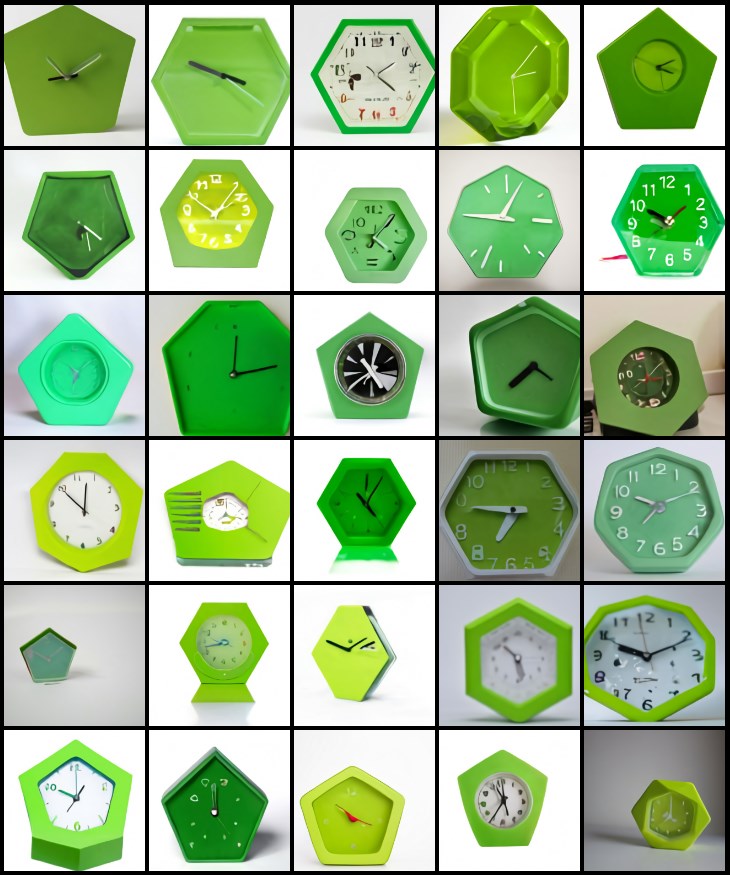

控制属性

研究人员测试了 DALL·E 修改目标物体的能力,包括修改相应的属性以及出现的次数。

文本提示:五边形的绿色钟。

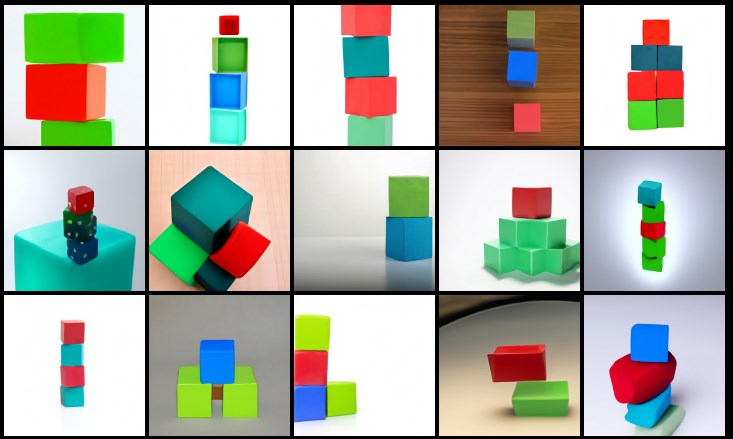

绘制多个目标

同时控制多个目标物体、以及它们的属性、空间关系是一个全新的挑战。

例如,“一只戴着红帽子、黄手套、蓝衬衫和绿裤子的刺猬”。要正确地解释这句话,DALL·E 不仅要正确地将每件衣服与动物组合在一起,还要将(帽子、红色)、(手套、黄色)、(衬衫、蓝色)和(裤子,绿色)形成各种联想,而且不能混淆它们。

文本提示:一堆三维立方体:红色的立方体在绿色立方体的顶部;绿色立方体在中间;蓝色立方体在底部。

虽然 DALL·E 确实为少量目标的属性和位置提供了某种程度的可控性,但成功率取决于标题文本的语言措辞。

随着目标的增多,DALL·E 容易混淆目标与颜色之间的关联,成功率会急剧降低。研究人员注意到,在这些场景中,DALL·E 对于标题文本的重新表述是脆弱的、可替代的,语义上等价的标题文本通常不会产生正确的解释。

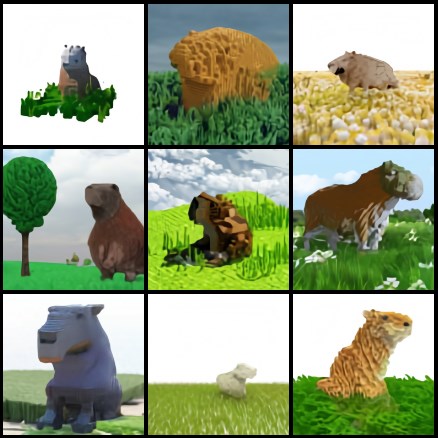

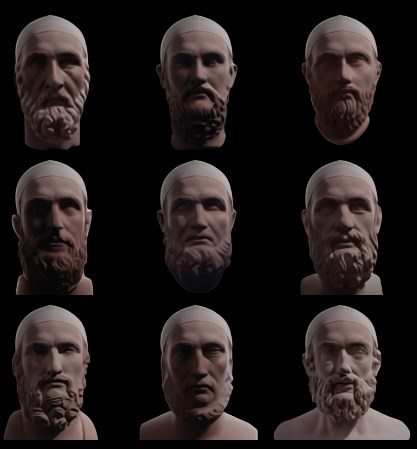

可视化透视与三维

研究人员发现 DALL·E 还能够控制场景的视点和渲染场景的 3D 样式。

文本提示:坐在田野上的像素化模型水豚。

为了进一步验证 DALL·E 的这个能力,研究人员测试了 DALL·E 在同等视角下重复绘制知名人物头部的能力,并发现 DALL·E 可以成功恢复旋转头部的平滑动画。

文本提示: 荷马半身像。

DALL·E 能够将某些类型的光学畸变(Optical Distortions)应用到具体场景中,正如我们在 “鱼眼透镜视图(Fisheye Lens View)”和 “球形全景图(Spherical Panorama.)”等场景中看到的那样。它促使研究人员探索其产生光学反射的能力。

文本提示:一个白色的立方体看着自己在镜子里的倒影;一个白色的立方体看着镜子里的自己。

可视化内部和外部结构

“特写镜头(Extreme Close-up View)”和 “x 射线(X-Ray)”风格的案例使研究人员进一步探索了 DALL·E 运用横截面视角绘制内部结构和用宏观图像绘制外部结构的能力。

文本提示:核桃的横截面图。

推断上下文细节

将文本翻译成图像的任务是不明确的:一个标题文本通常可以对应无限多种图像,换句话说,图像不是唯一确定的。例如,假如标题文本是 “日出时,坐在田野上的水豚的绘画像。根据水豚的方位,可能需要画一个阴影,但这个细节没有被明确提及。

研究人员探讨了 DALL·E 在以下三种情况下解决无规范标准问题的能力:改变风格、设置和时间;在各种不同的情况下绘制同一目标图像;在生成目标图像上书写指定文本。

文本提示:带有蓝色草莓的彩色玻璃窗。

利用不同程度的可靠性,DALL·E 为通过自然语言实现 3D 渲染引擎功能提供了一种途径。它可以独立地控制少量目标的属性,并在有限的范围内控制目标的数量以及它们之间的排列方式。它还可以控制渲染场景的位置和角度,并且根据角度和照明条件生成精确且规范的已知目标。

与 3D 渲染引擎不同,3D 渲染引擎的输入必须明确且完整,当标题文本暗示图像必须包含未明确的特定细节时,DALL·E 通常能够 “填补空白”。

应用案例

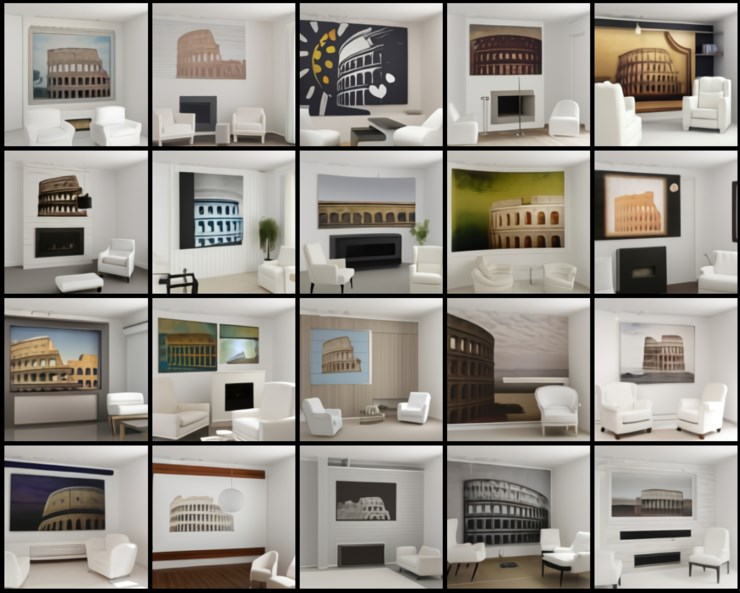

研究人员探讨了上述功能在时尚设计和室内设计中的应用。

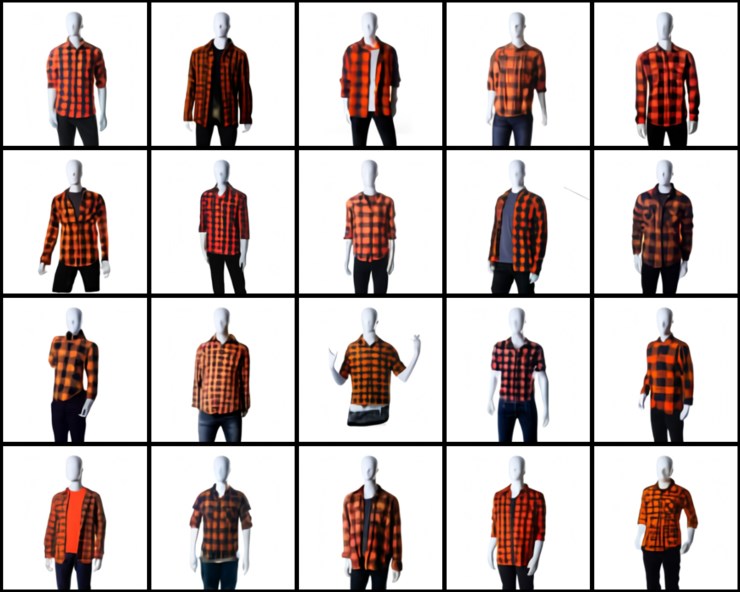

文本提示:一位穿着橘色和黑色相间衬衫的男性人体模特。

文本提示:客厅中有两个白色的扶手椅和一幅斗兽场的画,这幅画挂在现代样式壁炉的上方。AI 生成的图像:

组合不相关的概念

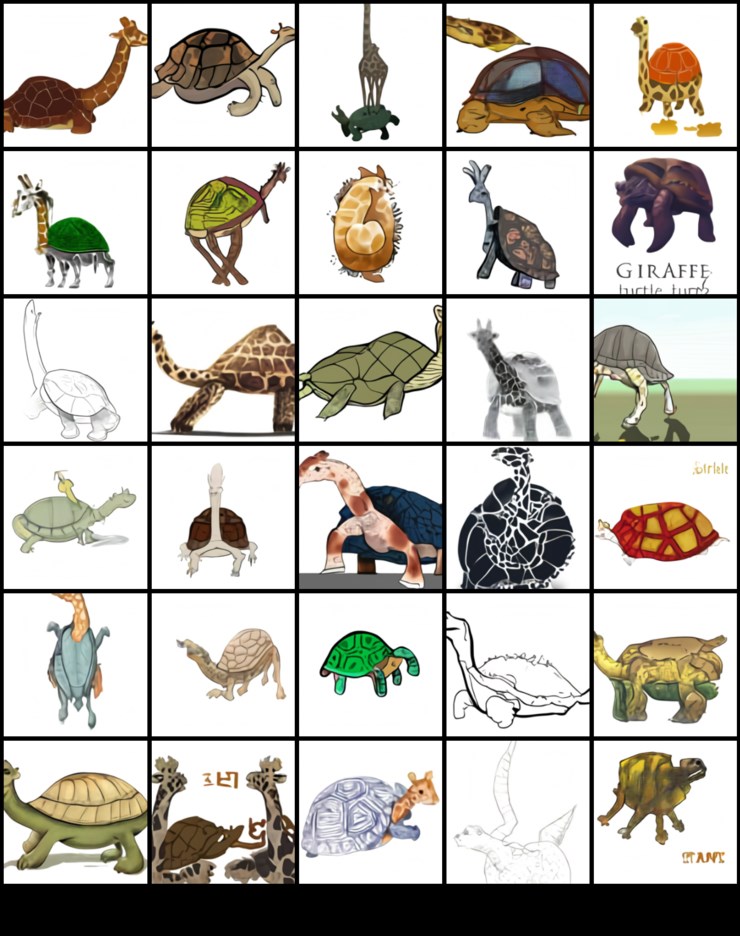

语言的构成本质使人们能够将概念描述集成在一起,用以描述真实和虚构的事物。OpenAI 发现,DALL·E 还具有将完全不同的 idea 结合起来以合成物体的能力,其中有些物体不可能在现实世界中存在。

OpenA 在两种情况下探索这种能力:将各种概念的特质传递给动物,以及从不相关的概念中汲取灵感来设计产品。

文本提示:竖琴状的蜗牛。

在上一部分中探讨了 DALL·E 在生成真实物体的图像时结合无关概念的能力。接下来,OpenAI 通过在艺术的背景下的三种插图探索这种能力:动物和物体的拟人化版本、动物嵌合体、表情符号。

文本提示:长颈鹿乌龟合体的专业高质量插图,模仿乌龟的长颈鹿,由乌龟变成的长颈鹿。

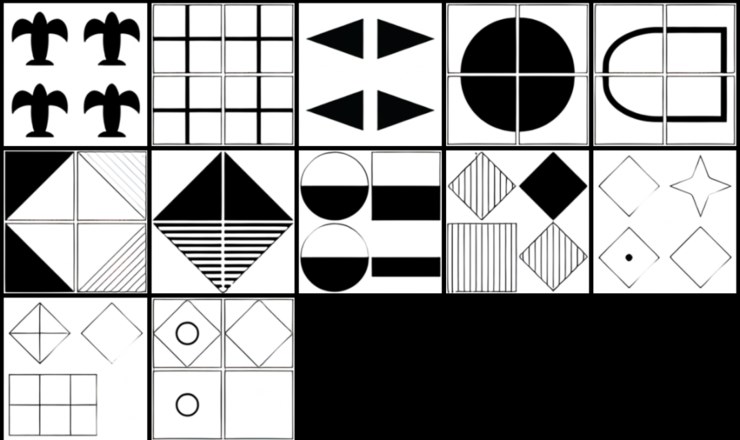

零样本视觉推理

可以仅根据说明和提示来指示 GPT-3 执行多种任务,而无需任何额外训练。例如,当提示短语 “将‘在公园里遛狗的人’被翻译成法语:”时,GPT-3 会回答 “un homme quipromèneson chien dans le parc。此功能称为零样本推理。

OpenAI 发现 DALL·E 将此功能扩展到了视觉领域,并且在以正确的方式提示时,能够执行多种图像到图像的翻译任务。

文本 + 图像提示:参照上面的猫在下面生成草图。

OpenAI 惊讶地发现 DALL·E 居然有这种神奇的能力,因为他们没有对神经网络或训练程序进行任何修改。

受这些结果的启发,OpenAI 通过在 Raven 的渐进矩阵上进行测试来衡量 DALL·E 对于解决类推推理问题的能力,这是一种视觉智商测试,在 20 世纪得到了广泛应用。

文本 + 图像提示:一个几何形状序列。

地理知识

OpenAI 发现 DALL·E 了解地理事实、地标和街区。它对这些概念的了解在某些方面出奇地精确,而在另一些方面却有缺陷。

文本提示:中国食物的图片。

时间知识

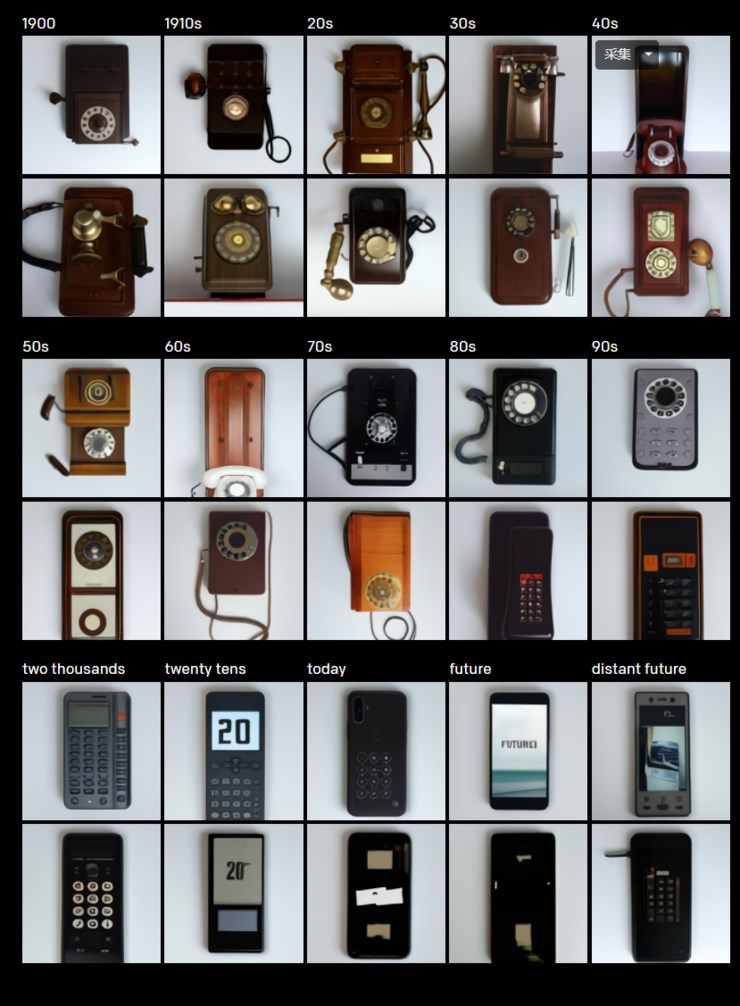

除了探索 DALL·E 关于随空间变化的概念的知识外,OpenAI 还探索了其随时间变化的概念的知识。

文本 + 图像提示:20 年代发明的电话。

总结:方法和先前工作

DALL·E 是一个仅有解码器的 Transformer 架构,它可以接收 1280 个 token 的文本和图像作为单个流(文本为 256 个 token,图像为 1024 个 token),并对它们全部进行自动回归建模。

它的 64 个自注意力层中的每一个都具有注意力 mask,使每个图像 token 都可以匹配所有文本 token。DALL·E 对文本 token 使用标准的因果 mask,以行、列或卷积注意模式对图像 token 使用稀疏注意,具体取决于层数。

OpenAI 计划在下一篇论文中提供有关 DALL·E 架构和训练过程的详细信息。

与 VQVAE-2 中使用的 rejection sampling 类似,OpenAI 使用 CLIP 对每个文本生成的 512 个采样中的前 32 个进行排名。此过程也可以看作是一种语言指导的搜索,会对样本质量产生巨大影响。

GPT-3 已经向我们展示,可以用语言来指示大型神经网络执行各种文本生成任务。Image GPT 则表明,同样类型的神经网络也可以用来生成高保真的图像。OpenAI 进一步扩展了这些发现,以表明通过语言操纵视觉概念是触手可及的。

与 GPT-3 一样,DALL·E 是一种 Transformer 语言模型。OpenAI 认为,涉及生成模型的工作可能会产生重大而广泛的社会影响。因此未来,OpenAI 会计划分析像 DALL·E 这样的模型如何与社会问题联系起来,例如对某些工作流程和专业的经济影响,模型输出中可能存在的偏见以及该技术所隐含的长期道德挑战。

最后,Henry AI Labs 在 YouTube 上分享了一个视频,简要介绍了 OpenAI 的 DALL-E 模型,并表示 “希望可以清楚说明深度神经网络中文本和图像是如何作为张量统一的。”

由于是非官方解释,仅供参考。

最后,大家对 DALL·E 这个的神经网络模型有什么应用上的期待呢?二维设计师?

又会觉得它会引导什么 AI 革命吗?又或者觉得它会存在很多不可避免的限制?